Le nouveau modèle Gato de Deepmind est incroyable !

Gato de DeepMind vient d'être publié ! Il s'agit d'un seul modèle à base de transformeur qui peut jouer à des jeux Atari, sous-titrer des images, discuter avec des gens, contrôler un vrai bras robotique, et plus encore ! En effet, il est entraîné qu’une seule fois et utilise les mêmes poids pour accomplir toutes ces tâches. Et selon Deepmind, ce n'est pas seulement un transformeur, mais aussi un agent. C'est ce qui se passe lorsque vous mélangez Transformeurs avec des progrès sur des agents d'apprentissage par renforcement multitâches.

Gato est un agent multimodal. Cela signifie qu'il peut créer des légendes pour des images ou répondre aux questions en tant que chatbot. Vous diriez que GPT-3 peut déjà faire cela, mais Gato peut faire plus… La multimodalité vient du fait que Gato peut également jouer à des jeux Atari au niveau humain ou même effectuer des tâches du monde réel comme contrôler des bras robotiques pour déplacer les objets avec précision. Il comprend les mots, les images et même la physique.

Un agent généraliste. Image tirée de l'article de Deepmind.

Gato est le premier modèle généraliste qui fonctionne si bien sur tant de tâches différentes, et c'est extrêmement prometteur pour le domaine. Il a été formé sur 604 tâches distinctes avec des modalités, des observations et des spécifications d'action variables, ce qui en fait le parfait généraliste.

Et comme je l'ai dit, il fait tout cela avec le même réseau et les mêmes poids (et avant que vous ne demandiez, il n'a besoin “que” de 1,2 milliard de paramètres par rapport à GPT-3, qui en nécessite 175 milliards !). Ce n'est pas un piège où vous devez le ré-entraîner ou l’ajuster pour toutes les tâches.

Vous pouvez envoyer à la fois une image et du texte, et il fonctionnera. Vous pouvez même ajouter quelques mouvements d'un bras de robot ! Le modèle peut décider du type de sortie à fournir en fonction de son contexte, allant du texte à des actions discrètes dans un environnement.

La phase d'entraînement de Gato. Image tirée de l'article de Deepmind.

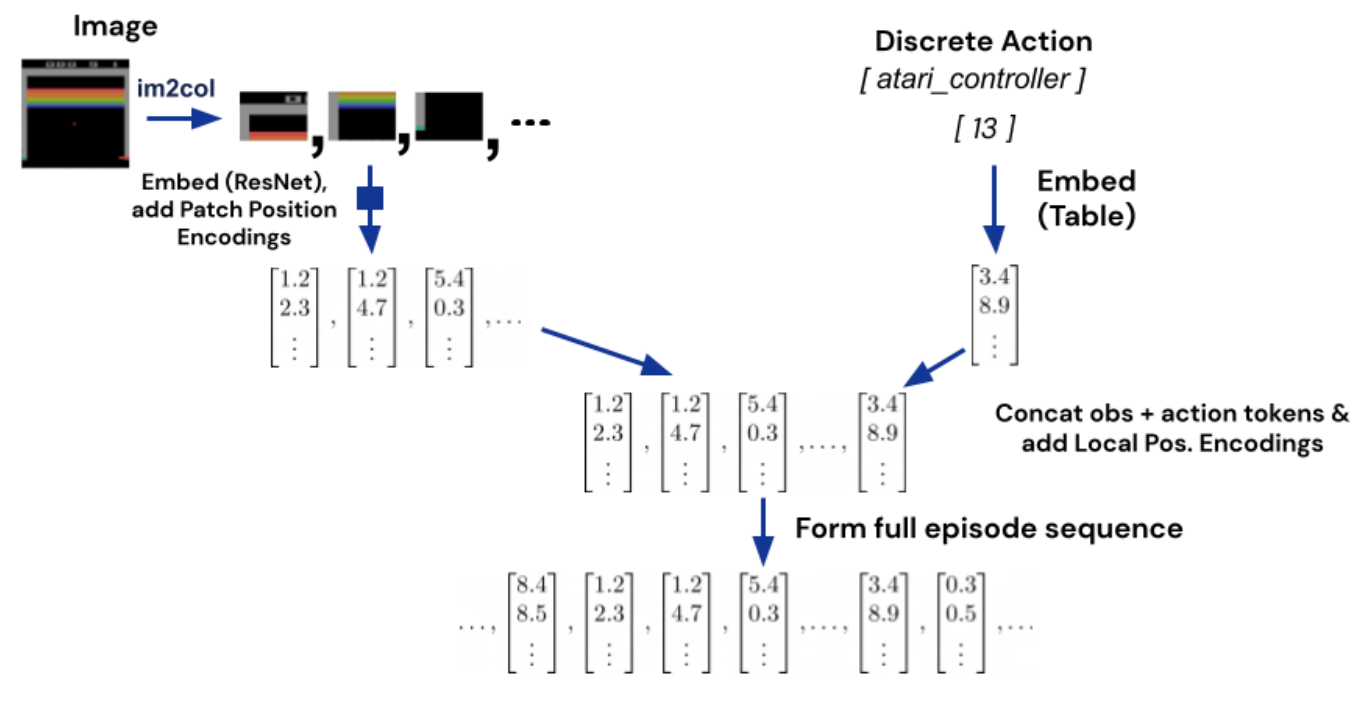

Cela est possible grâce à leur processus de tokenisation. La tokenisation consiste à préparer vos entrées pour le modèle, car ces modèles ne comprennent pas le texte ou les images par eux-mêmes. Les modèles de langage et Gato prennentnombre total de sous-mots, par exemple, 32000, et chaque mot a un numéro qui lui est attribué.

Pour les images, ils suivent la technique de patch utilisé dans ViT à l'aide d'un bloc ResNet largement utilisé, comme nous l'avons vu dans des articles précédents. Nous symbolisons également les pressions sur les boutons sous forme de nombres entiers pour les jeux Atari ou de valeurs discrètes.

Processus de tokenisation d'images et d'actions discrètes. Image tirée de l'article de Deepmind.

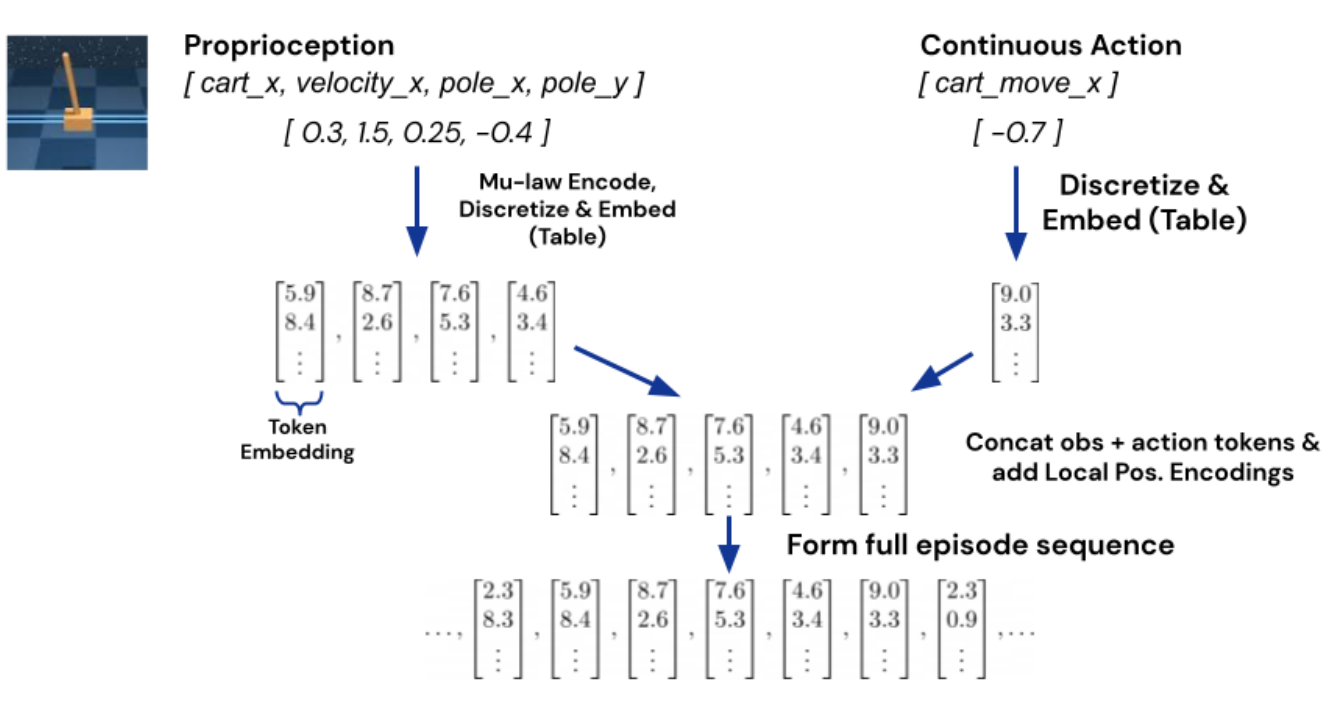

Enfin, pour les valeurs continues comme les entrées proprioceptives dont nous avons parlé avec les bras robotiques, ils ont encodé les différentes métriques suivies en nombres flottants et les ont ajoutés après les jetons de texte.

Proprioception et processus de tokenisation de l'action continue. Image tirée de l'article de Deepmind.

En utilisant toutes ces différentes entrées, l'agent s'adapte à la tâche en cours pour générer les sorties appropriées. Pendant la formation, ils utilisent un conditionnement comme dans GPT-3 avec des actions et des observations préalablement échantillonnées, représenté à gauche dans l’image ci-dessous.

Exécution de Gato en tant que stratégie de contrôle. Image tirée de l'article de Deepmind.

Les progrès des agents RL généralistes au cours des dernières années ont été incroyables et sont venus principalement de Deepmind. On pourrait dire qu'ils se rapprochent de l'IA générale (AGI) ou de l'intelligence au niveau humain (si nous pouvons enfin la définir). J'aime la quantité de détails qu'ils ont donné dans leur article au sujet de l’entraînement et du modèle en tant que tel. J'ai hâte de voir ce qu'ils vont faire, ou ce que d'autres vont faire, en utilisant cette architecture !

Le lien vers l'article pour plus d'informations sur le modèle se trouve dans la description.

J'espère que ce court article vous a plu. J’ai pris connaissance de cette nouvelle quand je me suis réveillé et j'ai dû la couvrir avant de faire quoi que ce soit d'autre dans ma journée. C'est juste trop excitant !

Je vous verrai la semaine prochaine avec un autre article incroyable!

References

►Regardez la vidéo sous-titrée en français: https://youtu.be/xZKSWNv6Esc

►Blog de Deepmind: https://www.deepmind.com/publications/a-generalist-agent

►Paper, Reed S. et al., 2022, Deemind: Gato. https://storage.googleapis.com/deepmind-media/A%20Generalist%20Agent/Generalist%20Agent.pdf

►Ma Newsletter (en anglais): https://www.louisbouchard.ai/newsletter/